美國網路安全與基礎設施安全局 (CISA)、聯邦調查局 (FBI)、國家安全局 (NSA) 人工智慧安全中心、澳洲信號局澳洲網路安全中心、加拿大網路安全中心、德國聯邦資訊安全辦公室、荷蘭國家網路安全中心、紐西蘭國家網路安全中心和英國國家網路安全中心聯合發布了一份 25 頁的指導文件,內容涉及在營運技術 (OT) 環境中部署人工智慧環境。

雖然人工智慧(例如大規模語言模型 (LLM))可以用來提高效率和決策能力,但它也存在一些風險,例如 OT 流程模型隨時間推移而發生漂移以及繞過安全流程。

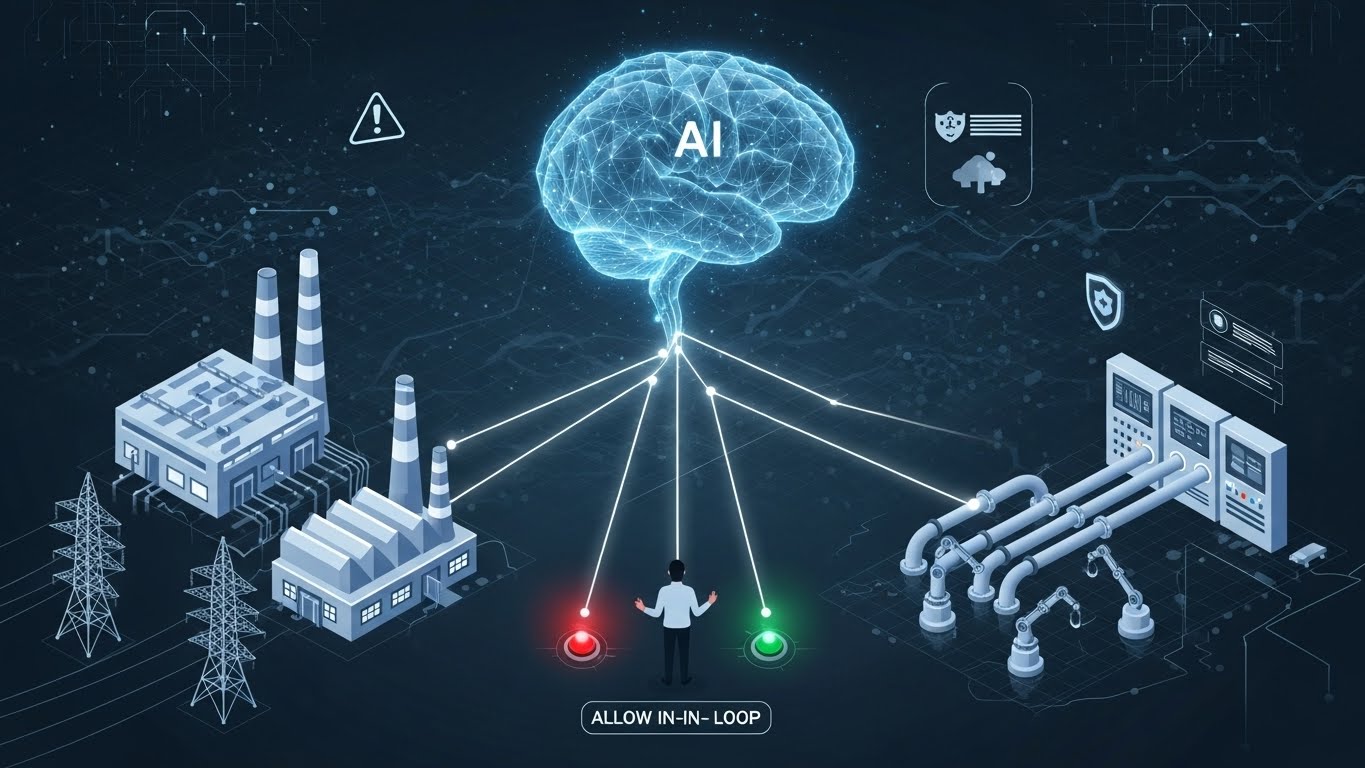

該指南建議了解人工智慧在 OT 中的應用,建立治理和保障框架,在 OT-AI 整合中實施安全保障,並實施人工參與的監控和故障保護措施。

Fortinet 的 Richard Springer 表示,OT 專注於基本的網路安全,例如網路分段和資產視覺化,而 GenAI 的應用還很有限。

Darktrace 的 Nathaniel Jones 指出,LLM 可能會提出與安全限制不一致的建議,並且已被認定為 OT 中的高風險技術。

從: ![]() CISA 出版社發布的《在 OT 中使用人工智慧的安全指南》

CISA 出版社發布的《在 OT 中使用人工智慧的安全指南》

【社論】

將人工智慧融入營運技術(OT)環境的趨勢已經進入了一個新階段,現在的問題不再是“做還是不做”,而是“如何安全地實施”。美國網路安全和基礎設施安全局(CISA)與各國國家網路安全中心(NCSC)近期聯合發布的指南,可以被視為在全球範圍內「扭轉局面,轉向安全」的信號。目前,人工智慧正開始對電力、水務、製造和國防等領域的營運技術系統產生直接影響。

營運技術 (OT) 的一個顯著特徵是,一次故障就可能對人類生命和社會基礎設施造成直接損害。因此,本文檔明確指出,“雖然人工智慧 (AI) 可用於高級異常檢測和優化,但必須依賴人為判斷和故障保護措施”,並且“LLM 的風險尤其高,因此直接將其用於行為分析和異常檢測可能是一個錯誤”。隨著越來越多的標準(例如 NERC CIP-015)要求進行行為分析,本文檔必須糾正「只需安裝 LLM 即可」這種簡單粗暴的想法。

關鍵技術問題在於「模型隨時間推移的漂移」以及「機率人工智慧與確定性運作技術之間的衝突」。當運行條件或負載曲線發生變化時,人工智慧可能會開始基於與訓練期間不同的假設提出建議,這可能導致控制方案偏離安全裕度。正如Darktrace所指出的,營運技術本質上是一個高度確定性的領域,因此直接使用機率輸出進行控制的設計需要根本性的重新思考。

從營運層面來看,該聲明也頗具實用性:「我們不應一開始就假定人工智慧的存在,而應重新審視其作為營運技術(OT)業務案例的必要性。」鑑於許多企業在業務細分和資產管理方面仍處於起步階段,其基調是,與其將全能人工智慧(GenAI)置於核心地位,不如從間接應用入手,例如流程自動化和預測性支援。這一立場與日本目前正在討論的營運技術安全指南和控制系統(CS)最佳實踐並不衝突。

從監管和標準化的角度來看,這份文件表明,「人工智慧在營運技術中的應用」不再是各公司各自為政的局部實驗,而是開始被視為電力、製造和水務等行業的「系統性風險」。展望未來,監管機構和客戶極有可能要求能源和製造業的企業將人工智慧使用政策、治理和模型評估流程作為常規程序進行記錄。

從正面來看,將人工智慧融入營運技術(OT)有望實現更準確、更快速的異常早期檢測、預測性維護以及複雜警報的分類,而這些以往都依賴人類的直覺和經驗。然而,為了充分發揮這些優勢,必須在系統設計和操作流程中明確界定「人工智慧應承擔多少責任,以及人類應承擔哪些責任」。這些指導原則應作為國際上統一這些界限和前提條件的首要參考點。

[術語]

大規模語言模型(LLM)

這是一個通用術語,指的是能夠從大量文字資料中學習並產生類似於人類寫作的回應、摘要、翻譯等的 AI 模型。

營運技術 (OT)

用於監測和控制物理過程(例如工廠設施、發電廠以及供水和污水處理系統)的技術和系統的總稱。

SCADA(監控與資料收集)

該系統用於遠端監控和控制工業工廠和基礎設施,收集感測器數據並發送控制命令。

遠端程式碼執行 (RCE)

這是一種漏洞/攻擊方法,允許攻擊者遠端執行任意程式碼,從而可能導致系統被接管。

模型漂移(隨時間推移的漂移)

這是由於運行環境和輸入資料的變化,導致人工智慧模型的輸出結果與訓練過程中做出的假設結果隨時間推移而偏差的現象。

人機交互

這指的是一種運作模式,在這種模式下,人工智慧不會自動做出決策,而是會加入一個由人類審查和批准重要決策的流程。

故障安全<br>一種設計理念,即即使發生故障或失靈,系統也能恢復到安全狀態,從而最大限度地減少損失。

行為分析和異常檢測<br>一種安全技術,它學習正常的行為模式並檢測偏離這些模式的行為,用於監控 OT 和關鍵基礎設施。

[參考連結]

CISA(網路安全與基礎設施安全局) (外部)

美國國土安全部下屬機構,負責提高關鍵基礎設施和政府機構的網路安全和實體安全。

聯邦調查局(FBI) (外部)

美國司法部下屬的調查機構,負責調查和收集聯邦犯罪(包括網路犯罪)的情報。

美國國家安全局人工智慧安全中心(外部)

作為美國國家安全局 (NSA) 的一部分,該中心專注於人工智慧安全,致力於人工智慧的安全使用和防禦。

澳洲網路安全中心(ACSC) (外部)

澳洲政府網路安全機構,為公共和私營部門提供威脅資訊和指導。

加拿大網路安全中心(外部)

加拿大政府網路安全專業機構,負責處理安全事件回應並發布最佳實踐。

德國聯邦資訊安全辦公室 (BSI) (外部)

他在德國聯邦資訊安全辦公室負責制定國家資訊科技安全標準和進行威脅分析。

荷蘭國家網路安全中心(NCSC-NL) (外部)

荷蘭政府的國家網路安全中心 (NCSC) 為公共部門和關鍵基礎設施營運商提供安全資訊和指導方針。

紐西蘭國家網路安全中心(外部)

他在新西蘭政府網路安全中心工作,為關鍵組織提供事件回應支援和建議。

英國國家網路安全中心(NCSC) (外部)

作為英國政府通訊總部 (GCHQ) 的一個部門,它為政府、企業和公民提供網路安全指導和事件回應。

Darktrace (外部)

該公司提供利用人工智慧的網路防禦產品,並為包括 OT 和雲端在內的各種環境開發異常檢測解決方案。

Fortinet (外部)

它是一家全球安全廠商,提供防火牆和OT安全產品。

Nozomi Networks (外部)

一家為 OT 和 IoT 提供可視化和威脅檢測解決方案的安全公司。

NERC CIP-015 (外部)

這是北美電力可靠性委員會 (NERC) 的關鍵基礎設施保護標準之一,規定了包括行為分析和異常檢測在內的安全要求。

IPA控制系統安全(外部)

由日本資訊科技促進機構(獨立的行政機構)經營的控制系統安全資訊網站總結了OT和ICS的風險和對策。

[參考文章]

聯合指南:人工智慧在營運技術中安全整合的原則(外部)

CISA 和國家網路安全機構發布的官方指導文件詳細介紹了 OT 中的具體原則,例如 AI 用例、風險、治理、測試、監控和故障保護。

NERC CIP-015 標準檔(外部)

該標準規定了電力行業的網路安全要求,包括行為分析和異常檢測,並作為討論在營運技術中使用人工智慧以及LLM適用性的基礎。

控制系統安全 | 資訊安全局 (IPA) (外部)

本頁總結了日本控制系統/OT安全方面的風險和應對措施,以及參考資料,並參考以確認與國際OT安全討論的一致性。

什麼是營運技術 (OT)?它與資訊科技 (IT) 和安全(外部)有何區別?

本文概述了 OT 和 IT 之間的差異、OT 安全的特性和典型風險,並用於確認 OT 環境的特徵以及對關鍵基礎設施的影響範圍。

[編者註]

將人工智慧融入營運技術(OT)的話題或許聽起來有些遙遠,但實際上它與我們日常生活中電力、水和交通等基本需求息息相關。在閱讀本文時,我希望您能花點時間思考一下:“如果您要在工作場所引入人工智能,您會在多大程度上放手讓人工智能來處理,又會在多大程度上希望由人類來掌控?”

如果您有任何實際經驗或疑慮,或者您希望人工智慧在哪些領域發揮更大作用,請在社群媒體上告訴我們。我們很樂意在未來的文章中與您深入探討這些主題。